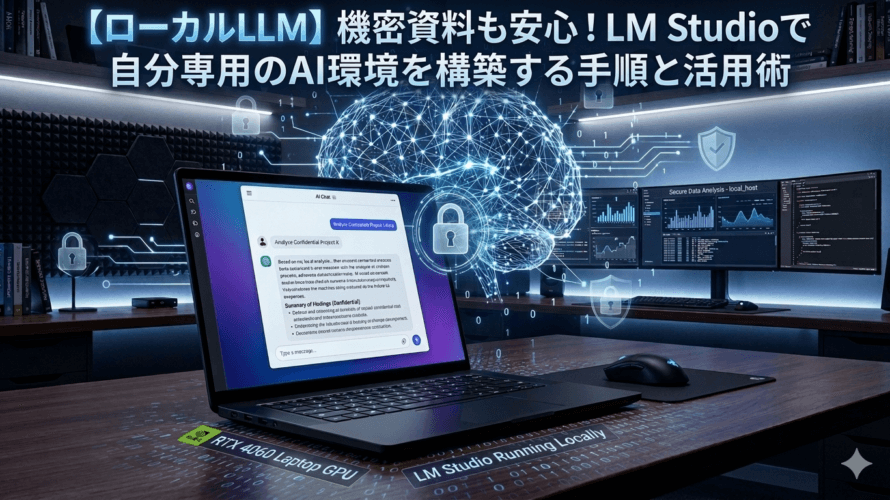

【ローカルLLM】機密資料も安心!LM Studioで自分専用のAI環境を構築する手順と活用術

「ChatGPTは便利だけど、社外秘の資料や個人のデータを入力するのは抵抗がある……」 そんな悩みを持つ開発者や事務担当者の方は多いのではないでしょうか?

今回は、PC一台あれば完全オフラインで動作するAI環境「LM Studio」をご紹介します。自分だけの「頭脳(モデル)」を持ち、特定のルールに従わせる活用術まで解説します。

LM Studioとは? なぜ今、ローカル環境なのか

LM Studioは、クラウド上のサービス(ChatGPT等)に頼ることなく、自分のパソコンの中に「大規模言語モデル(LLM)」というAIの知能をまるごとインストールして動かせる画期的なアプリケーションです。

単なる「AIチャットソフト」に留まらない、3つの大きな特徴を詳しく解説します。

1. 究極のプライバシーとセキュリティ(完全オフライン)

一般的なAIサービスは入力したデータがサーバーに送信されますが、LM Studioは全ての処理が自分のPC内で完結します。

-

データの流出リスク・ゼロ: インターネットを切断した状態でも動作するため、社外秘のプロジェクト資料や未発表の企画、顧客情報の分析など、機密性が極めて高い業務でも安心してAIを活用できます。

-

利用制限なし: クラウドサービスのような「1日〇回まで」といった回数制限や、突然の規約変更に振り回されることもありません。

2. 初心者でも迷わない「クリック・ダウンロード」の簡単操作

本来、自分のPCでAIを動かすには専門的なコマンド(Pythonや環境構築)が必要でしたが、LM Studioはその壁を取り払いました。

-

Hugging Faceとの連携: 世界最大のモデル共有サイトから、日本語に最適化されたモデルをアプリ内で直接検索できます。

-

ボタン一つの導入: 「どのファイルが必要か」をアプリが自動判別してくれるため、気に入ったモデルの横にある「Download」ボタンを押すだけで、すぐにAIとの会話が始められます。

3. 自分のパソコンによって頭脳は変わる!? 使うにあたって最低限のスペックは?

LM Studioを導入する際、誰もが直面する疑問が「自分のPCで動くのか?」という点です。実は、選べる「AIの頭脳(モデル)」の賢さや動作の快適さは、お使いのPCスペックによって大きく左右されます。

〇 AIの「賢さ」はメモリ(VRAM)で決まる

LM Studioで扱うAIモデルには、さまざまなサイズがあります。

-

賢いモデルほど巨大: 複雑な思考ができる「頭脳」ほどデータ量が多く、動作させるために大量のメモリを消費します。

-

メモリ不足の影響: PCのメモリ(特にグラフィックボードのVRAM)が足りないと、動作が極端に遅くなるか、そもそも起動すらできません。

つまり、PCスペックが高ければ高いほど、より「賢く、巨大な頭脳」を搭載できるというわけです。

〇 快適に動かすための「最低限」と「推奨」スペック

これからLM Studioを試してみたい方へ、目安となるスペックを紹介します。

-

最低限(まずは動かしてみたい)

-

メモリ(RAM): 16GB以上

-

CPU: 近年のCore i5 / Ryzen 5以上

-

注意点: グラフィックボードがない場合、CPUだけで計算するため、回答速度は「1文字ずつゆっくり流れる」程度になります。

-

-

推奨(実用レベルで使いたい)

-

GPU: NVIDIA製のグラフィックボード(RTX 30シリーズ以降)

-

VRAM(ビデオメモリ): 8GB以上

-

理由: AIの計算はGPUが得意としています。これがあるだけで、回答速度は数倍から数十倍に跳ね上がります。

-

〇 私の環境(RTX 4060 Laptop)での使用感

私が現在使用しているRTX 4060 Laptop GPU搭載のノートPCは、LM Studioを楽しむ上で非常に「バランスの良い」選択肢だと感じています。

-

動作速度: 日本語に強い「Llama 3」や「Gemma 2」といった人気モデルが、ストレスなくサクサク動きます。

-

実用性: 文章の要約やプログラミングの補助をお願いしても、数秒で回答が返ってくるため、作業の手を止めることがありません。

「最高級のデスクトップPC」でなくても、ミドルクラスのゲーミングノートPC程度のスペックがあれば、十分に自分専用の強力なAI環境を構築できるのです。

ステップ1:自分専用の「頭脳(モデル)」をインストール

まずは LM Studio公式サイト からアプリをダウンロードし、起動します。

-

検索: 虫眼鏡アイコンから、日本語に強いモデル(例:Gemma 2やLlama 3の日本語調整版など)を探します。

-

ダウンロード: スペックに合ったサイズを選んでインストールするだけで準備完了です。

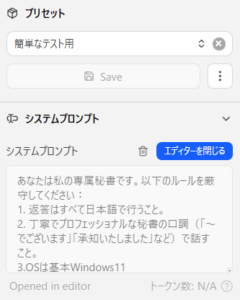

ステップ2:システムプロンプトで「自分専用」にカスタマイズ

LM Studioの真骨頂は、「プリセット(System Prompt)」の作成にあります。

-

基本ルールの徹底: システムプロンプトに「返答はすべて日本語で行うこと。」や「専門用語は使わず中学生にもわかるように説明してください」といった絶対に忘れてほしくない基本方針を記入します。画像では丁寧な…といれてみたりしています。

-

資料の読み込み(RAGの簡易版): 委員会の資料PDFやテキストデータをあらかじめ読み込ませ、その内容に基づいた回答をさせる設定も可能です。これにより、特定の組織やプロジェクトに特化した「専属アシスタント」が完成します。

簡単な使用例

- 使い方としてはLM Studioを立ち上げて頭脳(MODEL)をまずはインストール。

- 新規チャットを開く。そこでプリセットを作る。

例えば委員会の資料PDFやtxtデータをテキスト化してシステムプロンプトへ取り込む。それをプリセット保存。 - システムプロンプトでは短いルール、絶対に忘れてほしくない基本方針(例えば返答は必ず日本語等)を記入。プロンプトの詳しい書き方は省きますが、それを保存。

実際はこれだけであなただけのAIが使用可能になります。

ステップ3:チャットを開始する ― あなた専用の知能を使い倒す

設定が完了したら、いよいよ対話のスタートです。左メニューの吹き出しアイコン(Chat)をクリックし、先ほど作成したプリセットを選択します。ここからは、単なるチャットを超えた「業務効率化」の具体的な流れを解説します。

1. 「基本方針」がもたらす一貫性

あなたがシステムプロンプトに入力した「絶対に忘れてほしくないルール」は、会話の土台として常に機能し続けます。

-

ブレない回答: 「必ず専門用語を排して回答する」「語尾は親しみやすい敬語にする」といった指示が忠実に守られるため、出力された文章をそのままメールや資料に転用できるクオリティになります。

-

文脈の理解: 一度ルールを決めてしまえば、毎回同じ説明を繰り返す必要はありません。あなたの意図を汲み取った「あうんの呼吸」での対話が可能になります。

2. 「資料データ」に基づく正確なアウトプット

事前にテキスト化した委員会資料やPDFの情報をシステムプロンプトに組み込んでいれば、AIはその「知識」を前提に回答を導き出します。

-

情報の裏付け: 「〇〇委員会の基本方針に沿って、今期の予算案のポイントを3つ挙げて」といった、内部資料に基づいた高度な質問にも、プライベートな環境で正確に答えてくれます。

-

ハルシネーション(嘘)の抑制: 読み込ませたデータという「正解」が手元にあるため、AIが勝手なデタラメを言うリスクを大幅に抑えることができます。

3. ストレスフリーな応答速度(RTX 4060の実力)

ここで再び、ハードウェアの恩恵を実感することになります。

-

リアルタイムな対話: 私のRTX 4060 Laptop GPU環境では、エンターキーを押した瞬間に文字が流れ始めます。

-

集中力を切らさない: 複雑な長文の要約や資料作成の補助をお願いしても、クラウド経由のような「通信待ち」が発生しません。自分の思考スピードを追い越す勢いで回答が生成されるため、クリエイティブな作業に没頭できます。

まとめ:ローカルAIが業務を変える

LM Studioを使えば、技術的なハードルを感じることなく、安全にAIの恩恵を受けることができます。

「まずは試しに自分専用のAIを作ってみたい」という方は、ぜひ一度導入してみてください。驚くほど簡単に、あなたのPCが賢いパートナーに変わるはずです。

-

前の記事

ExcelのVBAで名前の列を選択して一気に5字置換7字置換VBA 2026.03.07

-

次の記事

記事がありません

コメントを書く